Sabiá-4

Estamos introduzindo nossa nova geração de modelos com Sabiazinho-4 e Sabiá-4, com melhorias no domínio jurídico, uso de contexto longo, seguir instruções e capacidades de agente.

Estamos lançando em versão preview o Sabiá-4, nosso modelo da próxima geração da família Sabiá, projetado com foco em custo e desempenho em tarefas complexas. Os modelos representam um avanço significativo em relação à geração anterior, especialmente nas áreas em que a versão antiga apresentava limitações.

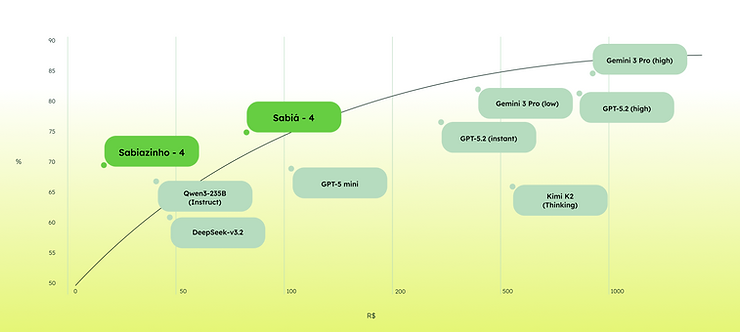

Figura 1: gráfico com custo (eixo X) vs qualidade (eixo Y) dos modelos avaliados.

Melhorias no pré-treino

Identificamos algumas limitações importantes em cenários mais exigentes para a geração antiga e melhoramos nosso pré‑treino para cobrir esses pontos:

- Domínio jurídico brasileiro — leis, súmulas, decisões e redação jurídica.

- Contexto longo — até 128 mil tokens, ideal para análise de processos e contratos.

- Conhecimento sobre o Brasil — atualidades, instituições e literatura nacional.

- Capacidades de agente — function calling estável e orquestração de ferramentas.

Melhorias no pós-treino

Também trouxemos melhorias no pós‑treino, especialmente para cobrir limitações da geração antiga:

- Seguimento de instruções — respostas mais consistentes e fiéis ao pedido.

- Chamada de funções (function calling) — execução correta em ambientes complexos.

- Busca na web — uso adequado de ferramentas externas quando disponíveis.

Avaliação em benchmarks

Os modelos foram avaliados em diversos benchmarks de avaliação. As tabelas abaixo apresentam o desempenho de modelos em faixas de custo diferentes.

| Benchmark | Sabiá-4 | Sabiá-3.1 | GPT-4.1 | GPT-5.2 s/ reasoning | GPT-5.2 reasoning | Gemini-3-Pro (reasoning low) | Gemini-3-Pro (reasoning high) | Kimi-k2- thinking | Qwen3- 235b- instruct-2507 | Deepseek- v3.2 |

|---|---|---|---|---|---|---|---|---|---|---|

| Custo | R$80,49 | R$62,15 | R$182,49 | R$307,12 | R$752,41 | R$403,31 | R$804,07 | R$516,52 | R$44,36 | R$49,22 |

| Leis brasileiras | 97,4 | 77,8 | 80,8 | 84,0 | 86,3 | 74,9 | 88,6 | 59,1 | 65,9 | 67,3 |

| OAB Bench | 7,49 | 7,21 | 7,30 | 8,07 | 8,73 | 9,05 | 8,90 | 6,62 | 6,33 | 6,40 |

| Magis Bench | 5,08 | 4,97 | 5,55 | 6,66 | 6,99 | 7,79 | 7,48 | 4,49 | 4,52 | 4,88 |

| Capacidades agênticas | 72,2 | 43,1 | 73,3 | 81,1 | 85,7 | 90,4 | 90,1 | 77,3 | 67,8 | 40,5 |

| Provas brasileiras | 86,6 | 82,4 | 86,1 | 88,0 | 92,9 | 93,3 | 95,0 | 83,0 | 82,0 | 84,0 |

| Multi-IF Português | 82,0 | 80,7 | 82,7 | 83,7 | 87,2 | 86,0 | 88,0 | 86,0 | 84,4 | 81,5 |

| BRACEval | 53,8 | 44,6 | 50,2 | 59,0 | 60,2 | 70,8 | 68,1 | 56,9 | 65,6 | 60,8 |

Tabela 1: Sabiá-4 — comparação de qualidade e custo entre modelos de fronteira.

Destacamos abaixo alguns dos principais benchmarks.

OAB-Bench

OAB-Bench é um benchmark criado para avaliar a capacidade de modelos de linguagem em tarefas complexas de escrita jurídica, usando como base a segunda fase do Exame da Ordem dos Advogados do Brasil (OAB).

O benchmark reúne 105 questões retiradas de edições recentes do exame, distribuídas em sete áreas do direito, e inclui as mesmas diretrizes de avaliação completas usadas por avaliadores humanos para garantir uma análise rigorosa e consistente.

Magis-Bench

Magis-Bench é um benchmark voltado à avaliação de modelos de linguagem em tarefas jurídicas de alta complexidade, com foco em concursos públicos para o cargo de juiz substituto no Brasil. O benchmark é construído a partir de provas reais e recentes de concursos públicos, abrangendo, para cada certame, uma prova discursiva e duas provas práticas: elaboração de sentença cível e elaboração de sentença criminal.

Ticket-Bench

Ticket Bench busca avaliar a capacidade dos modelos de operar uma plataforma de compra de ingressos de jogos de futebol. O ambiente fornece ao modelo informações sobre o usuário e a capacidade de buscar partidas, escolher assentos e finalizar a compra.

Pix-Bench

Pix-Bench avalia a capacidade de modelos auxiliarem em tarefas financeiras cotidianas, como realizar o pagamento de uma conta ou fazer um Pix para outra pessoa. Assumindo o papel de assistente de uma plataforma bancária, o modelo precisa interpretar o pedido do usuário e executar a ação correta.

MARCA (MAritaca Research Checklist evAluation)

MARCA é um benchmark que avalia as capacidades dos modelos de encontrar informação através de navegação na web, focando principalmente em perguntas que demandam busca em largura — isto é, que envolvem coletar e sintetizar informação de múltiplas fontes.

Cada pergunta do MARCA é acompanhada de um checklist, utilizado para avaliar a completude e a corretude da resposta do modelo.

CLIMB (CheckList-based Inference for Multihop with Browsing)

CLIMB é um benchmark projetado para testar a habilidade dos modelos em realizar buscas em cadeia até alcançar uma resposta final. É composto por perguntas complexas que exigem navegação encadeada (multi-hop) entre páginas para sintetizar a resposta correta.

Leis Brasileiras

Este benchmark foi elaborado para avaliar o conhecimento dos modelos sobre a legislação federal brasileira, que compreende mais de 50 mil atos normativos, incluindo leis, decretos e medidas provisórias.

As questões são de múltipla escolha e podem assumir duas variações: na primeira, o modelo recebe um trecho da legislação e deve identificar a lei à qual ele pertence; na segunda, o modelo deve identificar a referência exata do trecho.

Multi-IF

O Multi-IF é um benchmark que avalia se modelos são capazes de seguir instruções que se acumulam ao longo de uma conversa. Diferentemente da maioria dos testes de seguimento de instruções, que envolvem turnos isolados, o Multi-IF avalia a robustez do modelo ao longo de múltiplos turnos.

BRACeval (Brazilian Chat Evaluation)

BRACEval é um benchmark de perguntas abertas voltado à avaliação de chatbots em cenários de instruções complexas e diálogos multi-turno, com ênfase no conhecimento sobre o Brasil. Composto por 150 perguntas multi-turno distribuídas em 13 categorias que incluem tarefas contextualizadas ao Brasil — escrita criativa, roleplay, extração de informação, humanidades, entre outras.

Custo total

Ao calcular o custo real de um modelo de linguagem, é importante considerar todos os fatores envolvidos para obter uma visão completa e precisa. Embora o preço por token de entrada e saída seja um ponto central, ele não conta a história inteira: latência, número de tokens necessários por tarefa e custo por benchmark também importam.

| Benchmark | Sabiá-4 | Sabiá-3.1 | GPT-4.1 | GPT-5.2 s/ reasoning | GPT-5.2 reasoning | Gemini-3-Pro (reasoning low) | Gemini-3-Pro (reasoning high) | Kimi-k2- thinking | Qwen3- 235b- instruct | Deepseek- v3.2 |

|---|---|---|---|---|---|---|---|---|---|---|

| OAB Bench | R$3,06 | R$2,17 | R$6,26 | R$9,02 | R$22,03 | R$12,11 | R$26,15 | R$12,68 | R$1,43 | R$0,75 |

| Magis Bench | R$2,44 | R$1,74 | R$4,88 | R$9,33 | R$23,91 | R$14,39 | R$24,89 | R$8,07 | R$0,69 | R$0,49 |

| Leis brasileiras | R$7,18 | R$7,89 | R$13,73 | R$11,97 | R$37,38 | R$31,68 | R$86,33 | R$33,17 | R$1,99 | R$2,19 |

| Capacidades agênticas | R$35,97 | R$25,49 | R$102,15 | R$181,09 | R$467,29 | R$178,90 | R$224,55 | R$304,58 | R$27,47 | R$38,81 |

| Provas brasileiras | R$6,36 | R$4,38 | R$7,48 | R$4,21 | R$30,77 | R$36,32 | R$101,22 | R$41,37 | R$3,07 | R$1,65 |

| Multi-IF Português | R$16,08 | R$13,80 | R$28,73 | R$58,80 | R$97,76 | R$79,40 | R$206,23 | R$70,62 | R$5,43 | R$3,55 |

| BRACEval | R$2,38 | R$1,48 | R$3,74 | R$7,50 | R$13,51 | R$11,27 | R$28,50 | R$10,64 | R$0,90 | R$0,50 |

| Total | R$80,49 | R$62,15 | R$182,49 | R$307,12 | R$752,41 | R$403,31 | R$804,07 | R$516,52 | R$44,36 | R$49,22 |

Figura 11: Sabiá-4 — custos em reais para avaliar os modelos nos benchmarks divulgados.

Próximos passos

O lançamento dos modelos da geração 4 (Sabiazinho-4 e Sabiá-4) é um passo importante para o desenvolvimento de nossas próximas gerações de modelos. Você pode encontrar mais detalhes sobre como usar o novo modelo em nossa documentação: docs.maritaca.ai.